Deepfakes e privacidade: como evitar fraudes e manipulações online

Sumário

Os deepfakes estão cada vez mais sofisticados, tornando difícil distinguir o que é real do que foi manipulado por Inteligência Artificial (IA). Essa tecnologia, capaz de criar vídeos, áudios e imagens realistas, é usada tanto para fins criativos quanto para atividades fraudulentas. Com isso, surgem preocupações sérias sobre privacidade, segurança digital e manipulação de informações.

Neste artigo, vamos explorar como os deepfakes funcionam, os riscos associados e como se proteger contra essa ameaça crescente. Também discutiremos o impacto dos deepfakes no desenvolvimento de aplicativos, abordando os desafios na autenticação de usuários e as oportunidades para inovação com IA.

O que são deepfakes?

O termo “deepfake” surge da combinação de deep learning (aprendizado profundo) e fake (falso). Deep learning é uma técnica avançada de aprendizado de máquina que utiliza redes neurais para criar conteúdos multimídia, como vídeos e áudios, imitando com precisão feições, vozes e movimentos humanos. Esses conteúdos manipulados são tão convincentes que é extremamente difícil perceber a falsificação sem o uso de ferramentas de detecção especializadas.

Embora os deepfakes possam ser usados para entretenimento, como em filmes e vídeos criativos, sua utilização maliciosa tem gerado preocupações. Eles já foram empregados em casos de fraude financeira, manipulação política e difamação, o que levou à criação de ferramentas e regulamentações para combater a sua disseminação.

Principais tipos de deepfakes

Os deepfakes podem ser encontrados em diferentes formatos, cada um com sua própria finalidade e impacto. Conheça os principais:

1. Deepfake de vídeo

Os deepfakes de vídeo são a forma mais comum de falsificação. Nesse tipo de manipulação, a IA troca rostos em vídeos, fazendo com que pareça que uma pessoa disse ou fez algo que nunca ocorreu.

A tecnologia mapeia expressões faciais e sincroniza movimentos labiais, tornando as falsificações extremamente realistas e difíceis de detectar.

2. Deepfake de áudio

As falsificações de áudio podem imitar com precisão a voz de qualquer pessoa, reproduzindo padrões de fala e entonações. Golpes financeiros já foram registrados usando deepfakes de áudio, onde criminosos se passam por executivos de empresas e solicitam transferências bancárias fraudulentas.

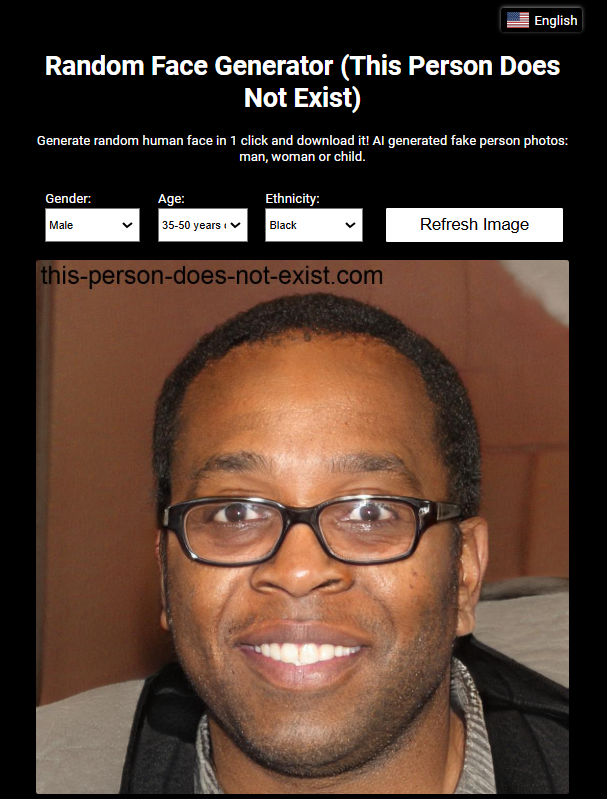

3. Deepfake de imagem

Os deepfakes de imagem são capazes de alterar rostos em fotos reais ou até criar pessoas que nunca existiram. Ferramentas como o “This Person Does Not Exist” geram rostos falsos com IA, que podem ser usados em sites e mídias sociais para enganar os usuários.

4. Deepfake de texto

A manipulação de textos também é possível com IA, que cria textos falsos imitando o estilo de escrita de qualquer pessoa. Essa técnica pode ser utilizada para espalhar desinformação, falsificar e-mails ou até gerar artigos que parecem autênticos, enganando leitores online.

Como identificar um deepfake?

Mesmo com os avanços da IA, ainda é possível identificar manipulações observando alguns sinais:

- Movimentos oculares anormais: Alguns deepfakes falham na reprodução de piscadas e movimentos naturais dos olhos.

- Expressões faciais artificiais: Pequenas distorções ao redor da boca e inconsistências na expressão podem indicar falsificação.

- Sincronização labial imperfeita: A boca pode não se movimentar de forma natural em relação ao áudio.

- Inconsistência na iluminação e sombras: Erros na iluminação do rosto ou sombras mal posicionadas são indícios de manipulação.

Ferramentas para detectar deepfakes

Existem plataformas especializadas na identificação de deepfakes, como:

- DeepFake Detection Challenge (DFDC): Projeto da Meta para desenvolver IAs que detectam deepfakes.

- Microsoft Video Authenticator: Analisa vídeos e sinaliza possíveis manipulações.

- Sensity AI: Plataforma dedicada à detecção de deepfakes.

- Google’s Deepfake Detection: Ferramenta baseada em aprendizado de máquina para identificar falsificações.

Como se proteger de deepfakes

Diante dos riscos associados aos deepfakes, algumas medidas podem ajudar a proteger sua privacidade e segurança digital:

- Verifique a fonte: Antes de compartilhar um vídeo ou áudio, confirme se a origem é confiável.

- Use autenticação multifator (MFA): Proteja suas contas contra roubo de identidade.

- Esteja atento a golpes: Empresas devem instruir seus funcionários a reconhecer técnicas de engenharia social que usam deepfakes.

- Utilize ferramentas de detecção: Plataformas especializadas podem ajudar a verificar a autenticidade de um conteúdo.

Leia também: Como aumentar a segurança do seu celular: 15 dicas essenciais.

Leis e regulamentações sobre deepfakes

Diante do avanço dos deepfakes e dos danos causados por essa tecnologia, governos ao redor do mundo estão criando leis para punir quem manipula e distribui conteúdos falsificados com intenções criminosas.

Regulamentação no Brasil

No Brasil, a Câmara dos Deputados aprovou um projeto de lei que inclui no Código Penal o crime de manipulação, produção ou divulgação de conteúdos de nudez ou ato sexual falso gerados por IA.

A matéria prevê pena de prisão de dois a seis anos para quem cometer essa infração, independentemente do meio utilizado. A pena pode ser aumentada em até metade se a vítima for mulher, criança, adolescente, pessoa idosa ou com deficiência (fonte).

A lei também contempla casos de assédio, chantagem e violação de direitos intelectuais.

Regulamentação Internacional

Outros países também vêm adotando medidas contra manipulações digitais:

- Estados Unidos: Algumas leis estaduais, como a da Califórnia, criminalizam o uso de deepfakes para enganar eleitores ou difamar candidatos políticos.

- União Europeia: O Regulamento de Serviços Digitais (DSA) exige que grandes plataformas digitais tomem medidas para combater deepfakes e outros conteúdos manipulados.

- China: Implementou uma lei que obriga criadores de deepfakes a rotularem o conteúdo como artificial.

Essas regulamentações demonstram o crescente esforço global para mitigar os impactos negativos dos deepfakes.

Como empresas podem se proteger de deepfakes

As empresas estão cada vez mais vulneráveis ao uso de deepfakes em golpes e fraudes. A seguir, algumas estratégias para reduzir esses riscos.

Investir em tecnologia de detecção

Empresas podem utilizar soluções de IA para detectar deepfakes. Ferramentas como Microsoft Video Authenticator e Google’s Deepfake Detection analisam vídeos e imagens em busca de sinais de manipulação.

Treinar equipes contra golpes virtuais

Os funcionários devem ser treinados para identificar possíveis deepfakes em e-mails, reuniões online e negociações. Golpes utilizando manipulações de voz podem enganar executivos e causar prejuízos financeiros.

Implementar verificação em múltiplas etapas

A autenticação multifator (MFA) ajuda a evitar fraudes, exigindo mais de uma forma de verificação para confirmar identidades.

Criar protocolos de segurança para comunicação interna

Empresas devem adotar práticas para garantir que comandos financeiros ou estratégicos sejam sempre confirmados por mais de um canal, reduzindo riscos de fraudes.

Monitorar ativamente a reputação digital

Monitorar menções à empresa nas redes sociais e na imprensa ajuda a detectar conteúdos manipulados antes que se espalhem.

O impacto dos deepfakes no desenvolvimento de aplicativos

Os deepfakes representam tanto desafios quanto oportunidades para desenvolvedores de aplicativos, especialmente no que se refere à segurança dos dados dos usuários. Com a crescente implementação de IA, a autenticação de usuários tem se tornado uma preocupação, levando ao uso de tecnologias como biometria avançada e verificação de identidade por IA.

No entanto, a manipulação de vídeos e áudios falsos pode ser usada para fraudes, expondo dados confidenciais dos clientes. Por isso, é fundamental que as empresas adotem medidas de segurança como criptografia, autenticação multifatorial (MFA) e protocolos de verificação robustos para evitar vazamentos de dados.

Apesar dos riscos associados ao uso dos deepfakes, a tecnologia subjacente apresenta vantagens significativas.

Ela pode ser empregada para desenvolver assistentes virtuais mais realistas e aprimorar a personalização da experiência do usuário. Além disso, inovações em ferramentas de edição de áudio e vídeo possibilitam a criação de conteúdos inovadores.

No entanto, a segurança deve ser prioridade. Garantir que dados dos usuários estejam protegidos e seguir regulamentações como a LGPD (Lei Geral de Proteção de Dados Pessoais) é essencial para manter a confiança dos clientes. Assim, as tecnologias podem ser aproveitadas de forma inovadora, mantendo a privacidade, segurança e integridade das pessoas.

Conclusão

Os deepfakes representam um grande desafio para a segurança digital, privacidade e confiabilidade das informações online. Com a disseminação dessa tecnologia, é essencial estar preparado para identificar e se proteger contra manipulações digitais.

A KXP Tech, especialista no desenvolvimento de aplicativos inovadores, está atenta a essas tendências e busca soluções tecnológicas para garantir segurança digital. Se você busca desenvolver um aplicativo seguro e moderno, entre em contato conosco e saiba como podemos ajudar!

7 Minutos de leitura

Camillo Rinaldi

Camillo Rinaldi é CTO da KXP Tech e especialista em desenvolvimento de produtos digitais, com mais de 8 anos de experiência em desenvolvimento mobile e arquitetura de sistemas. Ao longo da carreira, liderou o desenvolvimento de aplicativos e plataformas como Inner, Black Ticket e Toppayy, entre outros projetos voltados para diferentes mercados. Na KXP Tech, atua ajudando empresas e empreendedores a transformar ideias em produtos digitais escaláveis, desde a validação da ideia até o lançamento no mercado. Sua experiência combina desenvolvimento, estratégia de produto e visão de negócio. Ao longo dos anos, ele e sua equipe já ajudaram mais de 50 empresas a planejar, desenvolver e lançar seus aplicativos e sistemas, sempre com foco em qualidade, transparência e resultado. No blog, compartilha insights sobre tecnologia, inteligência artificial, desenvolvimento de sistemas e construção de produtos digitais, além de experiências reais do dia a dia criando soluções para startups e empresas.